相关概念

节点:节点是ComfyUI的重要组成成分。节点可以有多个输入和多个输出。

连线:不同的节点之间采用连线的方式进行协同工作。

连线只能从某个节点的输出连接到另一个节点的输入。

连线的两端必须是相同的类型。

工作流:所有的节点及其连线构成一个完整的工作流。

模型种类

checkpoint:模型检查点。可以理解为是基座模型。

stable diffusion自发布以来经历了多个大版本的迭代。总体上来说有1.5,2.0,XL,3.5。除了

SD系列之外,现在比较热门的还有FLUX(F.1)模型

Flux模型是由Black Forest Labs推出的一款先进的文本到图像生成模型,其团队成员包括Stable Diffusion的核心开发者。Flux模型以其卓越的图像质量、高度逼真的人体解剖学表现和先进的提示词遵循能力脱颖而出。

lora:权重微调。可以理解为在checkpoint的基础上的微调,让输出的图片效果偏向某个方向或风格。

clip:英文全称是Contrastive Language-Image Pre-training,由Open AI在2021年1月份提出并开源。即一种基于对比文本-图像对的预训练方法或者模型。CLIP是一种基于对比学习的多模态模型,CLIP的训练数据是文本—图像对:一张图像和它对应的文本描述,这里希望通过对比学习,模型能够学习到文本—图像对的匹配关系。

说人话:clip的功能就是将文字转化为潜空间向量。

那么什么又是潜空间呢?简单理解,潜空间就是计算机可以识别的一种空间状态。

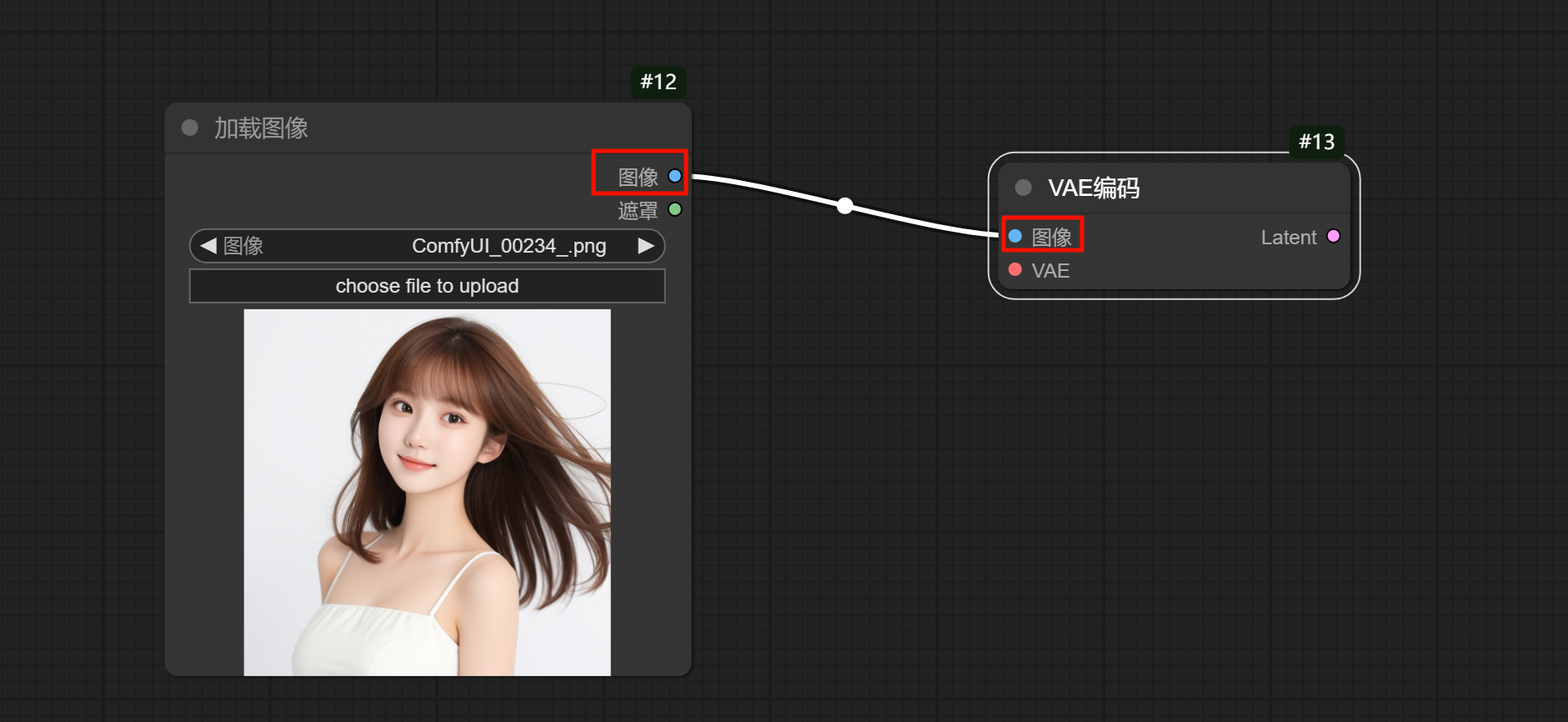

VAE:(变分自编码器)在图生图中的应用主要是通过其生成模型的能力来生成新的图像。VAE通过将输入数据映射到潜在空间,并从潜在空间中采样来重建输入数据,从而实现图像的生成。

说人话:

VAE的功能就是将图片在潜空间和现实空间进行相互转换。分别对应VAE编码和VAE解码。

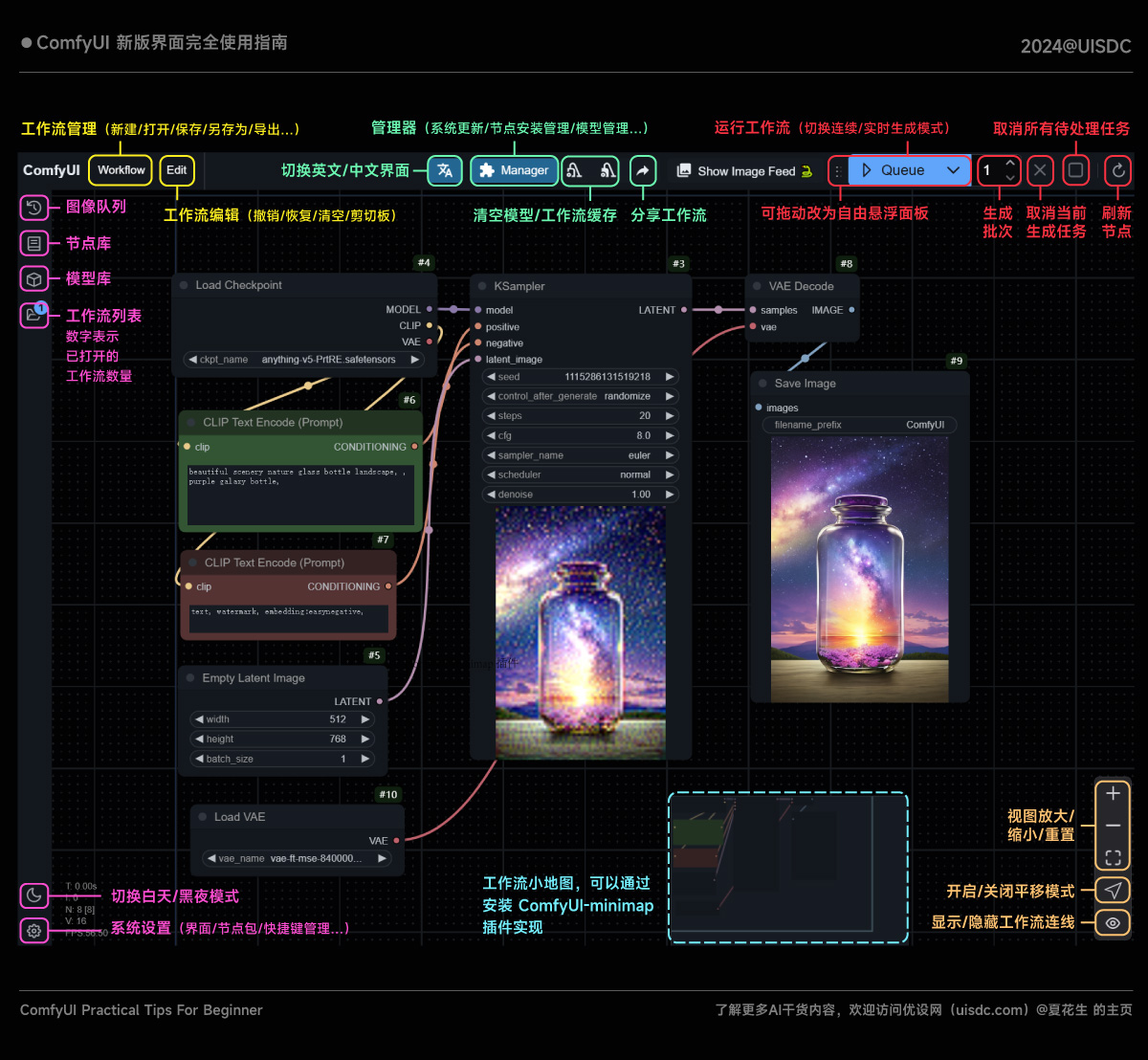

ComfyUI界面

常见操作

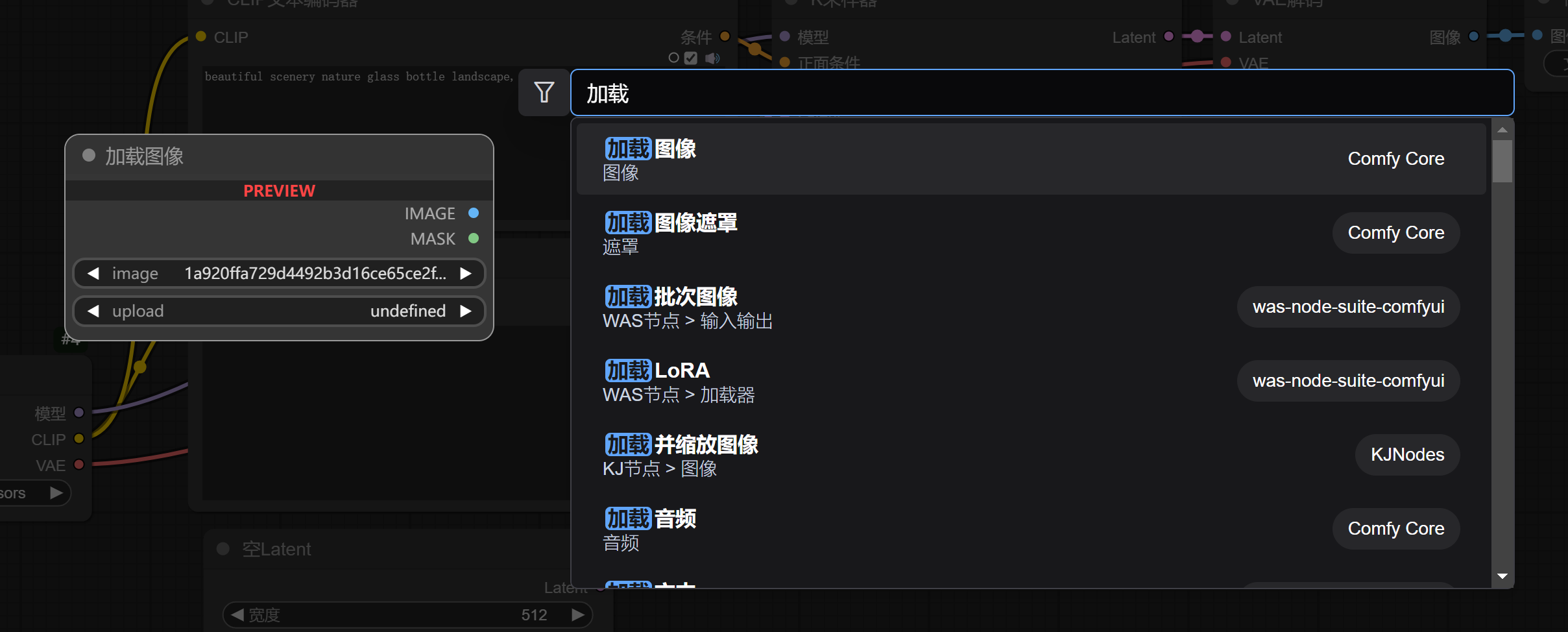

节点搜索

操作方式:双击空白处跳转到节点搜索。

节点连线

操作方式:鼠标左键按住节点输出按钮,然后拖拽即可拉出连线,找到与其相同的类型的节点输入即可完成连线。

如果当前工作空间中没有对应的输入节点可以直接连线,可以将其拖拽到空白处松开鼠标,即可唤出节点搜索框,搜索自己想要使用的节点,找到后会直接连接。

提交生图任务

工作流搭建完毕后,点击执行队列即可执行工作流。

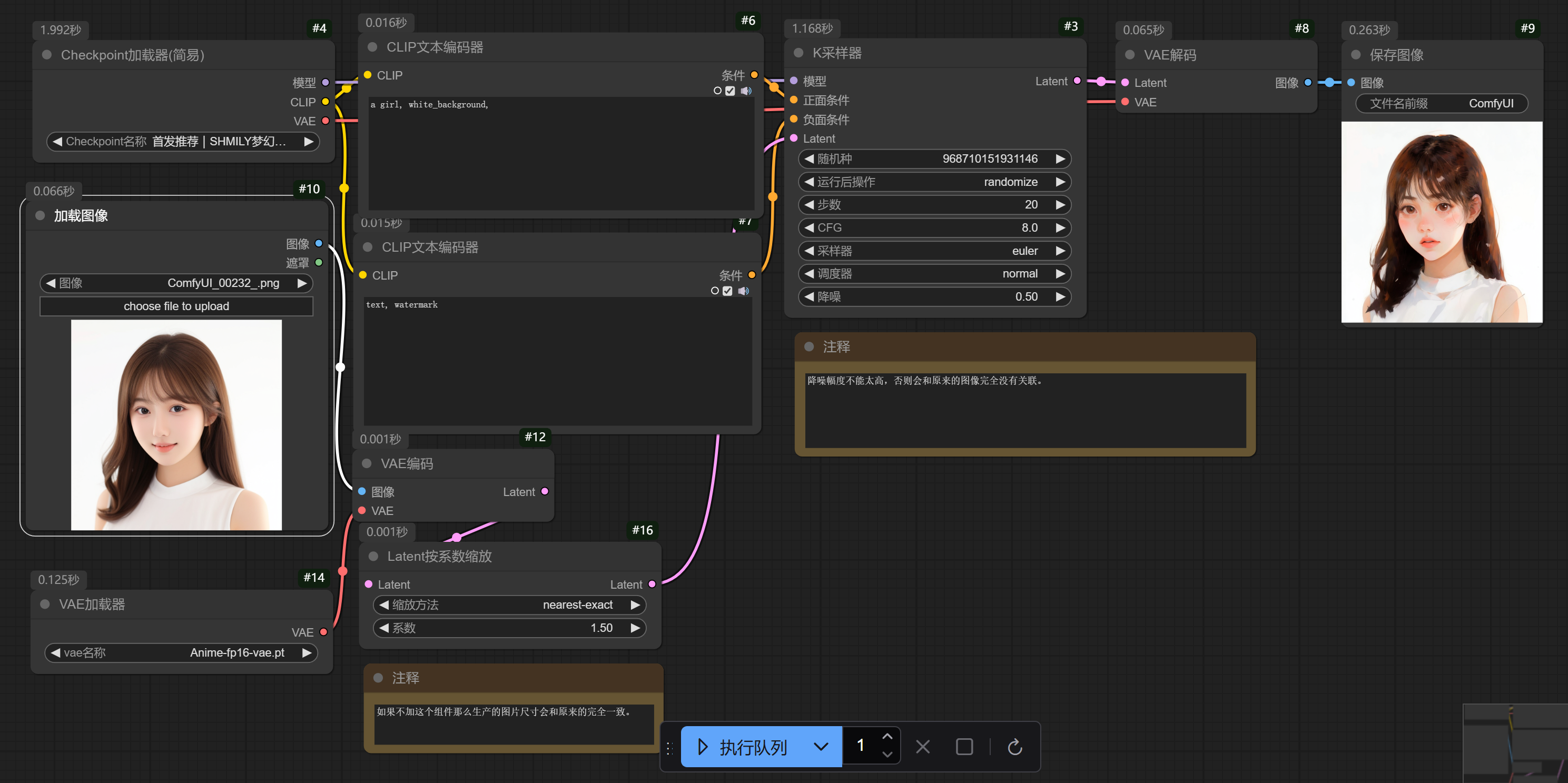

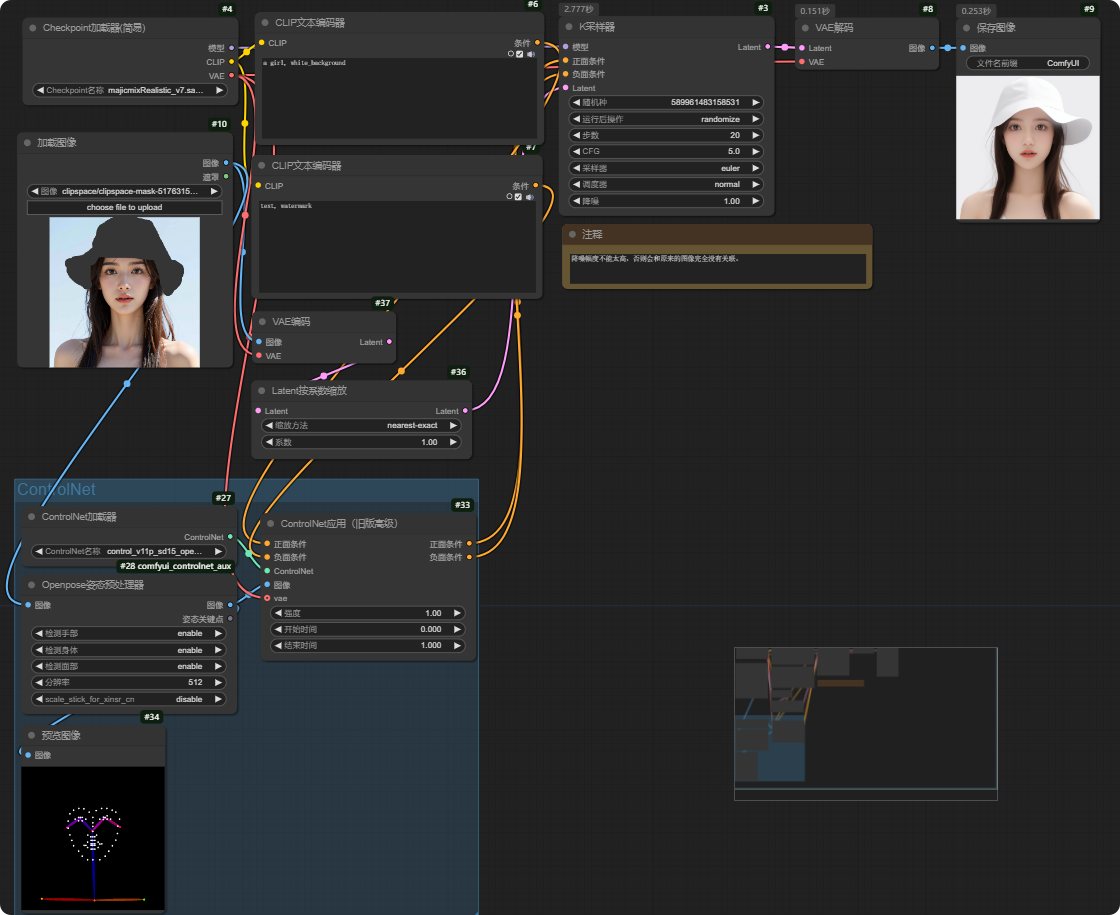

简易工作流

提示词

提示词与提示词之间需要使用逗号分隔,并且提示词可以换行。

每个提示词的默认权重为 1 ,越靠前的提示词权重相对越高,因此越需要强调的提示词,需要写在越靠前的位置。

常用正向提示词:

1 | HDR,UHD,8K(HDR、UHD、4K、8K和64K)——这样的质量词可以带来巨大的差异提升照片的质量 |

常用反向提示词:

1 | lowres , bad anatomy , bad hands , text , error ,missing fingers, |

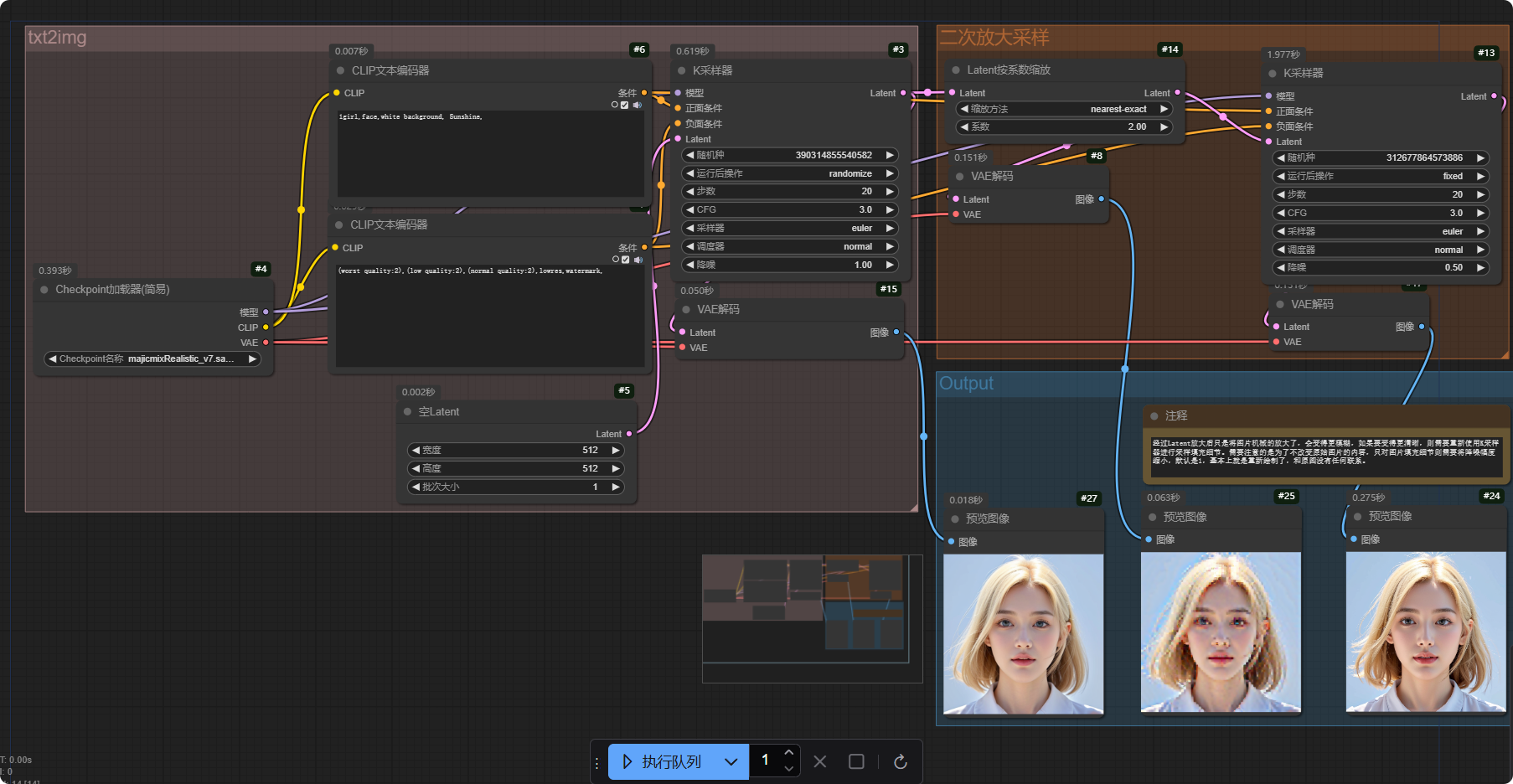

文生图

调参说明:

- 步数:降噪步数。

- CFG:提示词相关性。该值越大表示生成的结果约贴近提示词,但是过大会导致图像质量下降。

- 采样器:采样算法,会影响结果质量、生成速度、风格样式。

- 调度器:控制逐渐移除噪波的方法。

- 降噪:降噪的数值,降低该值会保留原图的大部分内容从而实现图生图。

图生图

图生图和文生图的过程基本相同,只是在latent部分需要传入一个对图像编码后的潜空间数据。

常用应用

图像高清放大(高清修复)

基本思想:对潜空间图像放大,然后再进行采样修复。

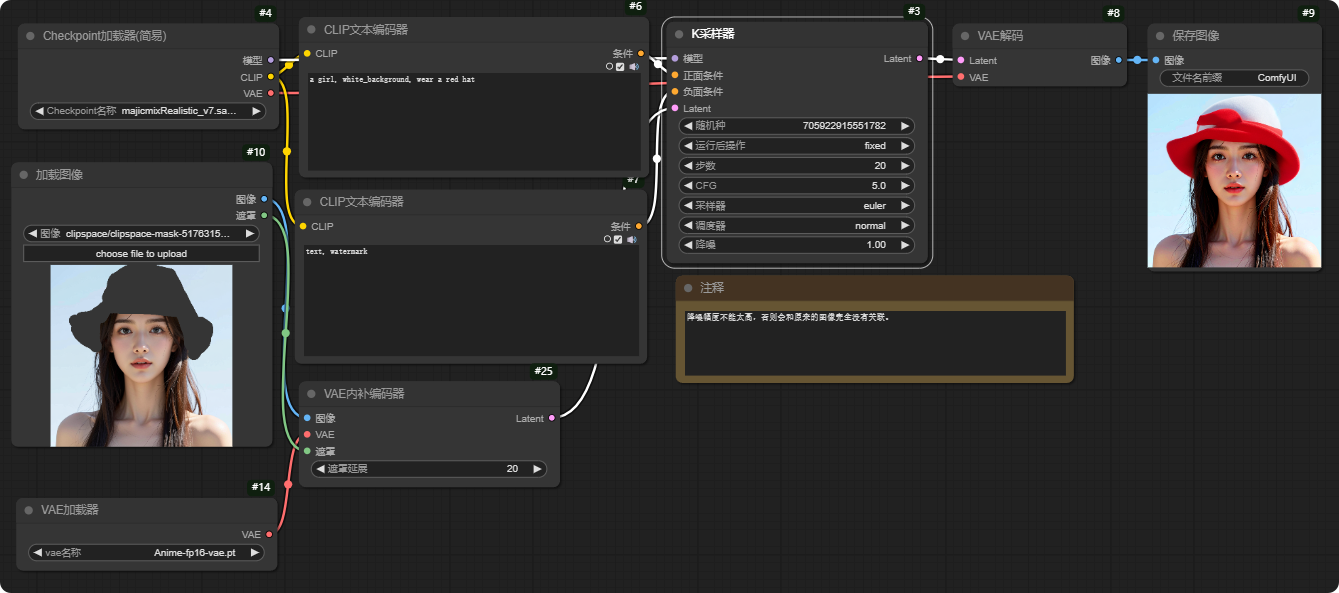

局部重绘

局部重绘,顾名思义就是将局部区域重绘为你想要的效果。

Controlnet

Controlnet:是一种用于增强图像生成的神经网络技术,特别适用于稳定扩散模型(Stable Diffusion Model)。它的目的是在不改变生成模型核心结构的情况下,增加对生成内容的控制。ControlNet 的主要思想是通过增加额外的控制信号来指导生成过程。这些控制信号可以是图像的边缘、草图、深度图或其他形态的信息。通过引入这些信号,ControlNet可以更好地满足用户对生成图像的特定要求。

其他工作流

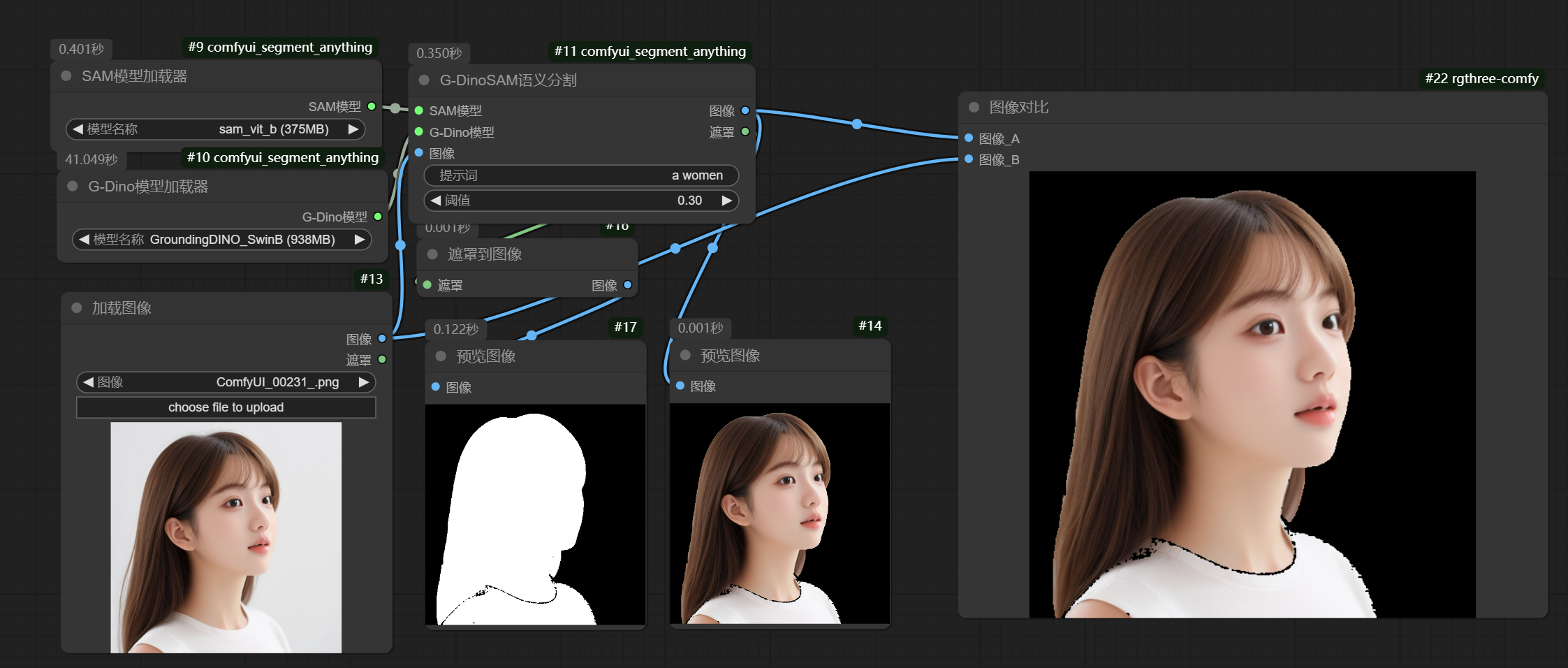

SAM-GDinoSAM一键抠图

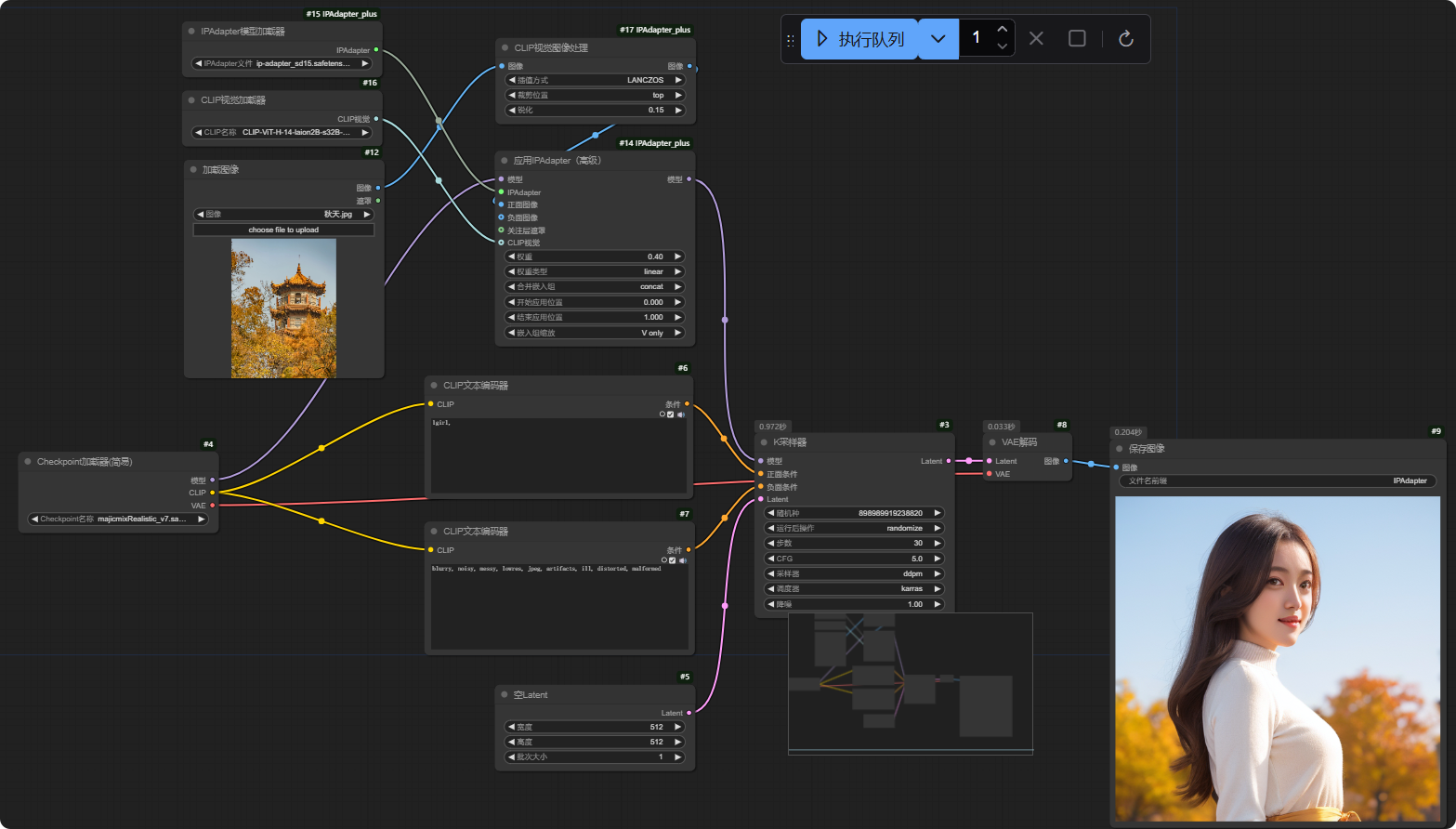

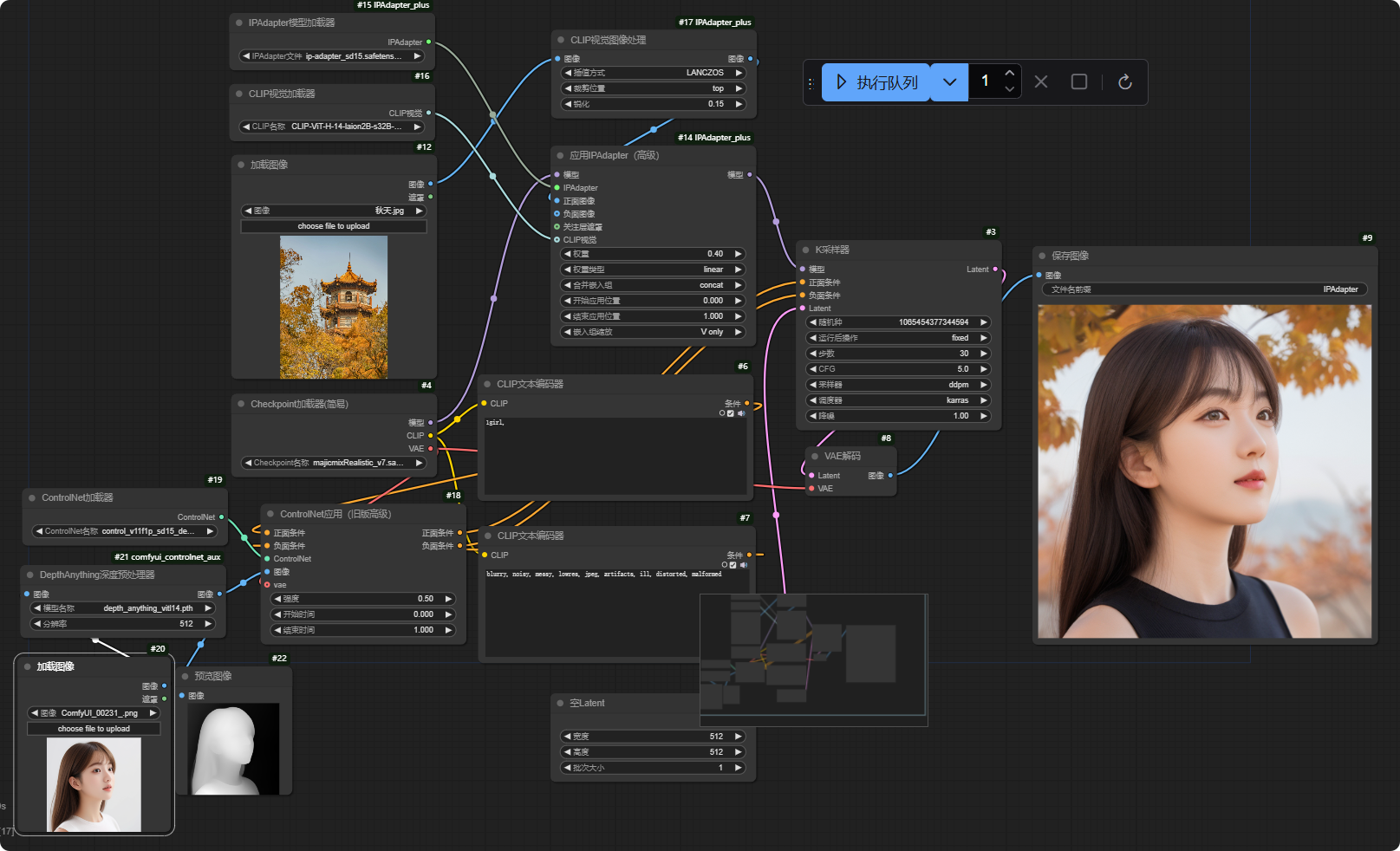

风格迁移

IPAdapter: 是一个轻量级的适配器,它的作用是将一张图像或几张图像的风格迁移到另一张图像上去。

结合前面提到的ControlNet可以达到将风景照风格迁移到人物照的效果。

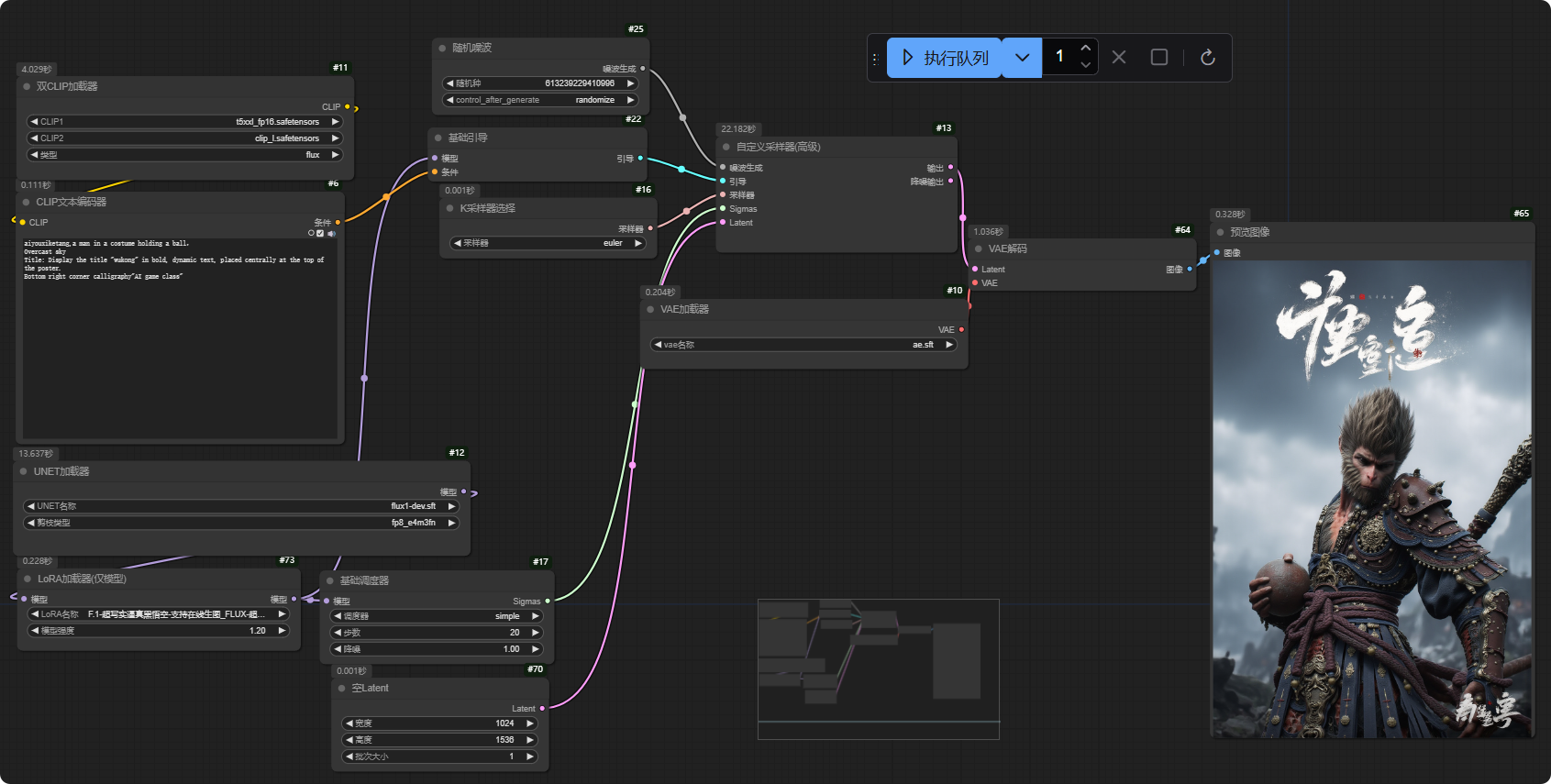

FLUX模型的使用

F.1模型在使用的时候和前面的SD系列不一样,需要通过不同的组件去分别导入UNET模型、CLIP模型和VAE模型。